Fast jede Woche erscheint ein neues KI-Modell. Mal ist es ein neues Claude-Modell, mal ein Qwen-Release, mal Gemini, OpenAI, Kimi oder ein starkes Open-Source-Modell. Und fast immer läuft die gleiche Choreografie ab: Das neue Modell sei jetzt „state of the art“, schlage die Konkurrenz in wichtigen Benchmarks und setze neue Maßstäbe bei Reasoning, Coding, Agent-Fähigkeiten oder multimodalen Aufgaben.

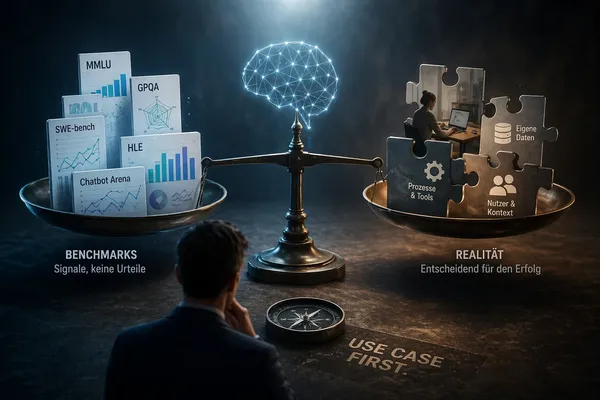

Für viele Nutzerinnen und Nutzer — und ehrlich gesagt auch für viele Entscheider in Unternehmen — entsteht dadurch eher Verwirrung als Klarheit. Denn fast niemand außerhalb der engeren KI-Bubble kann spontan beantworten, was MMLU-Pro, GPQA, HLE, SWE-bench oder Chatbot Arena eigentlich genau messen. Noch schwieriger ist die Frage, ob diese Benchmarks tatsächlich relevant sind, ob sie sauber gemessen wurden oder ob sie sich durch geschickte Präsentation und Evaluationstricks besser lesen, als sie in der Praxis wirklich sind.

Die wichtigste Erkenntnis vorweg ist deshalb diese: Benchmarks sind nützlich, aber sie sind kein Ersatz für Urteilsvermögen. Sie sind ein Signal, kein Urteil. Wer sie unkritisch liest, läuft Gefahr, Marketing mit Realität zu verwechseln. Wer sie dagegen richtig einordnet, kann aus ihnen sehr wohl wertvolle Hinweise ziehen — vor allem, wenn man versteht, welcher Benchmark für welche Fragestellung gebaut wurde.

Warum Benchmarks überhaupt existieren

Ohne Benchmarks wäre die Entwicklung von KI-Modellen kaum sinnvoll vergleichbar. Wenn ein Anbieter behauptet, sein Modell sei „besser“, muss es irgendeine Form von standardisierter Messung geben. Genau dafür gibt es Benchmarks: Sie stellen allen Modellen dieselben Aufgaben und vergleichen die Resultate nach definierten Kriterien.

Das klingt zunächst sehr vernünftig. In der Theorie ist ein Benchmark also nichts anderes als ein standardisierter Test. So wie man bei Menschen Sprachtests, IQ-Tests, Führerscheinprüfungen oder Uni-Klausuren kennt, gibt es bei KI-Modellen Tests für unterschiedliche Fähigkeiten: allgemeines Wissen, mathematisches Denken, Programmierung, Gesprächsqualität, Tool-Nutzung oder wissenschaftliches Reasoning.

Das Problem beginnt dort, wo aus diesem Test eine absolute Aussage gemacht wird. Denn jedes Benchmark-Ergebnis ist immer nur eine Aussage über eine bestimmte Art von Aufgaben unter bestimmten Bedingungen. Ein Modell kann in einem Mathematik-Benchmark hervorragend sein und trotzdem schwach im Schreiben von präzisen Mails. Es kann stark in akademischem Wissen sein und zugleich unzuverlässig in echten Kundenservice-Dialogen. Und es kann auf einem öffentlichen Benchmark sehr gut aussehen, weil genau auf solche Aufgaben hin optimiert wurde, ohne dass sich dieser Vorsprung im Alltag wirklich zeigt.

Deshalb sollte man Benchmarks nie als allgemeine Antwort auf die Frage „Welches Modell ist das beste?“ lesen. Die sinnvollere Frage lautet immer: Bestes Modell wofür?

Der größte Denkfehler: Nutzer suchen einen Sieger, Benchmarks messen Teilfähigkeiten

Viele Blogposts, Launch-Ankündigungen und Social-Media-Grafiken inszenieren Benchmarks wie einen Wettkampf mit klarer Rangliste. Modell A hat 91,3 Punkte, Modell B nur 89,7 — also muss A besser sein. Diese Logik ist verführerisch, aber oft falsch.

In Wahrheit messen Benchmarks meistens nur Teilbereiche:

- allgemeines Faktenwissen,

- mathematisches und logisches Denken,

- Code-Generierung,

- Konversationsqualität,

- wissenschaftliche Präzision,

- Agent- und Tool-Nutzung,

- Sicherheit und Robustheit.

Ein hoher Score in einer Kategorie sagt zunächst nur, dass das Modell in genau diesem Ausschnitt gut performt. Das ist wertvoll, aber eben begrenzt. Wer Benchmarks sinnvoll lesen will, muss daher immer zuerst klären, welche Fähigkeit überhaupt gemessen wird.

Ein Beispiel: Wenn ein Unternehmen ein Modell vor allem für interne Code-Assistance einsetzt, sind Benchmarks wie HumanEval oder SWE-bench deutlich relevanter als ein reiner Wissensbenchmark. Wenn der Anwendungsfall eher in Analyse, Strategiepapieren, Zusammenfassungen oder argumentativem Schreiben liegt, dann hilft ein hoher Mathematik-Score nur sehr begrenzt weiter. Und wenn es um sensible Fachgebiete wie Medizin, Forschung oder Engineering geht, gewinnen schwere Frontier-Benchmarks wie GPQA oder Humanity’s Last Exam an Bedeutung.

Welche Benchmarks heute als Marktstandard gelten

Es gibt keinen einzigen offiziellen Weltstandard, aber es gibt eine Gruppe von Benchmarks, die sich faktisch als gemeinsame Referenz etabliert haben. Diese Benchmarks begegnen einem immer wieder in Modellkarten, Leaderboards, Launch-Posts und Analysen.

1. Klassische General-Benchmarks

Zu den bekanntesten Benchmarks gehört MMLU beziehungsweise heute eher MMLU-Pro. MMLU steht für Massive Multitask Language Understanding und testet breites Wissen über viele Disziplinen hinweg. Es war über längere Zeit einer der wichtigsten Referenzwerte für allgemeine Modellintelligenz. Das Problem: Spitzenmodelle wurden mit der Zeit auf dem klassischen MMLU so gut, dass der Benchmark teilweise zu leicht wurde. Deshalb gewann MMLU-Pro an Bedeutung, weil diese Variante schwieriger und robuster ist.

Dann gibt es Benchmarks wie GSM8K und MATH, die sich auf mathematisches und schrittweises Reasoning konzentrieren. Diese Benchmarks sind sehr nützlich, um zu sehen, ob ein Modell sauber denken und rechnen kann. Gleichzeitig werden sie oft überinterpretiert. Ein Modell, das bei Mathematik exzellent ist, ist nicht automatisch auch das beste Modell für Wissensarbeit, Kommunikation oder RAG-Anwendungen.

HellaSwag, ARC und ähnliche Sets messen eher Common Sense, plausibles Sprachverständnis und einfachere Formen von Schlussfolgerung. Diese Tests sind weiterhin relevant, wirken heute aber im Vergleich zu neueren Frontier-Benchmarks oft etwas grundlegender.

2. Coding-Benchmarks

Für viele Unternehmen sind die Coding-Benchmarks inzwischen fast wichtiger als allgemeine Wissensbenchmarks. Hier sind insbesondere HumanEval, MBPP und SWE-bench zentral.

HumanEval prüft, ob ein Modell aus einer Aufgabenbeschreibung funktionierenden Python-Code erzeugen kann, der Unit-Tests besteht. Das ist ein guter schneller Indikator für Code-Qualität.

MBPP funktioniert ähnlich, ist aber eher einfacher und breiter.

SWE-bench ist deutlich praxisnäher. Hier geht es um echte GitHub-Issues in realen Repositories. Das Modell muss also nicht nur Code erzeugen, sondern ein Problem in einem größeren Software-Kontext verstehen und einen Patch liefern, der bestehende Tests besteht. Gerade für reale Softwareentwicklung ist SWE-bench deshalb oft wesentlich aussagekräftiger als einfache Coding-Benchmarks.

3. Chat- und Konversationsbenchmarks

Wenn Anbieter behaupten, ihr Modell sei im Dialog besonders stark, verweisen sie oft auf MT-Bench oder Chatbot Arena.

MT-Bench testet mehrstufige Gespräche und bewertet, wie hilfreich, kohärent und instruktionsgetreu ein Modell antwortet. Das ist nützlich, aber man sollte wissen: Solche Benchmarks verwenden teils andere starke Modelle als Richter. Das ist praktisch, kann aber auch Verzerrungen mit sich bringen.

Chatbot Arena ist besonders interessant, weil sie auf paarweisen Blindvergleichen basiert. Nutzer vergleichen Antworten verschiedener Modelle, ohne zu wissen, welches Modell dahinter steckt. Dadurch entsteht eine Art ELO-Ranking für Chatqualität. Dieses Ranking hat sich in der Praxis zu einem wichtigen Marktindikator entwickelt, weil es näher an echter Nutzerwahrnehmung ist als manche rein akademische Metrik.

4. Frontier-Benchmarks

In den letzten Jahren wurde klar, dass viele ältere Benchmarks für Spitzenmodelle zu leicht geworden sind. Deshalb entstanden neue, deutlich härtere Tests.

Hier sind vor allem drei Namen wichtig:

- MMLU-Pro

- GPQA

- Humanity’s Last Exam (HLE)

GPQA steht für Graduate-Level Google-Proof Q&A. Der Benchmark ist auf naturwissenschaftliche Fragen auf Graduiertenniveau ausgerichtet und soll so konstruiert sein, dass man die Antwort nicht einfach schnell googeln kann. Er ist besonders relevant, wenn es um wissenschaftliches Denken und tiefes Fachverständnis geht.

Humanity’s Last Exam ist gewissermaßen die Zuspitzung dieser Entwicklung. Der Name ist bewusst dramatisch gewählt, aber die Idee dahinter ist nachvollziehbar: Wenn klassische Benchmarks saturieren, braucht man Aufgaben, an denen selbst sehr starke Modelle noch klar scheitern können. HLE soll genau das leisten. Der Benchmark enthält extrem schwierige, fachlich anspruchsvolle Fragen aus vielen Disziplinen und ist deshalb heute einer der wichtigsten Referenzpunkte für „Frontier Reasoning“.

Warum Humanity’s Last Exam plötzlich so wichtig wurde

Dass viele Menschen HLE inzwischen als besonders wichtig wahrnehmen, liegt an einem realen Problem der Benchmark-Welt: Sättigung. Wenn fast alle Top-Modelle auf älteren Benchmarks sehr hohe Werte erreichen, verlieren diese Benchmarks ihre Unterscheidungskraft.

Ein Benchmark ist nur dann hilfreich, wenn er Unterschiede sichtbar macht. Wenn mehrere Modelle alle im Bereich von 90 Prozent und höher liegen, kann man aus kleinen Differenzen kaum noch belastbare Schlüsse ziehen. Dann wird ein Score von 91,2 gegen 89,8 schnell zum Marketinginstrument statt zur echten Erkenntnisquelle.

HLE versucht, dieses Problem zu lösen, indem es die Messlatte massiv höher legt. Es geht dort nicht um „Kann das Modell grob mitreden?“, sondern eher um „Kann dieses System auf einem Niveau bestehen, das in manchen Bereichen an Expertenwissen heranreicht?“ Genau deshalb ist HLE heute in vielen Diskussionen über Frontier-Modelle so prominent.

Wichtig ist aber auch hier: Ein Modell, das auf HLE stark ist, ist nicht automatisch das beste Modell für deinen konkreten Arbeitsalltag. HLE misst Tiefe in schwierigen Fachfragen — nicht automatisch Schreibstil, UX, Zuverlässigkeit im Tool-Calling oder Wirtschaftlichkeit im Einsatz.

Die häufigsten Tricks bei Benchmark-Ergebnissen

Nun zum heiklen Teil: Benchmarks können korrekt sein und trotzdem ein schiefes Bild erzeugen. Nicht immer steckt dahinter böse Absicht. Oft reicht schon eine geschickte Auswahl der Darstellung.

Cherry-Picking

Der häufigste Trick ist selektive Auswahl. Ein Anbieter zeigt nur genau die Benchmarks, auf denen sein Modell besonders gut abschneidet. Andere Benchmarks, auf denen der Vorsprung kleiner ist oder die Konkurrenz vorne liegt, tauchen gar nicht auf.

Für Leser wirkt das wie ein klarer Gesamtsieg, obwohl es in Wirklichkeit nur ein Teilsieg in ausgewählten Kategorien ist.

Unfaire Vergleichsbedingungen

Manchmal werden Modelle nicht unter exakt gleichen Bedingungen verglichen. Ein Modell bekommt vielleicht mehr Kontext, mehr Rechenbudget, mehrere Versuche oder eine aufwendigere Prompting-Strategie. Ein anderes wird dagegen eher konservativ evaluiert. Formal steht dann vielleicht in beiden Fällen ein Benchmark-Score, faktisch ist der Vergleich aber nicht sauber.

Überoptimierung auf bekannte Tests

Sobald ein Benchmark öffentlich bekannt und wichtig wird, beginnen viele Teams, direkt oder indirekt auf diesen Benchmark hin zu optimieren. Das kann bewusst oder unbewusst geschehen. In der Folge steigen die Ergebnisse, ohne dass die allgemeine Nützlichkeit im gleichen Maß zunimmt.

Das ist ähnlich wie bei standardisierten Schultests: Wer gezielt für den Test trainiert, verbessert den Score — aber nicht zwangsläufig die dahinterliegende allgemeine Fähigkeit.

LLM-as-a-Judge-Probleme

Gerade bei Chat- und Stil-Benchmarks werden Bewertungen oft durch andere Modelle vorgenommen. Das spart Kosten und skaliert gut. Es kann aber Verzerrungen erzeugen. Je nachdem, welches Richtermodell verwendet wird und wie es gepromptet ist, können bestimmte Antwortstile oder Anbieter systematisch bevorzugt werden.

Winzige Unterschiede als großer Durchbruch verkauft

Ein weiteres typisches Muster: Ein Anbieter verbessert sich in einem Benchmark um einen oder zwei Punkte und präsentiert das wie einen generellen Paradigmenwechsel. In Wahrheit können solche Unterschiede, gerade bei hohen Scores, im Alltag kaum spürbar sein.

Die entscheidende Frage lautet daher immer: Ist der Unterschied groß genug, robust genug und relevant genug, um in meinem Anwendungsfall wirklich einen Unterschied zu machen?

Wie man Benchmarks als Nutzer sinnvoll lesen sollte

Wer Benchmark-Charts sieht, sollte sich an eine einfache Reihenfolge halten.

Erstens: Welcher Anwendungsfall interessiert mich?

Bevor man irgendeinen Score interpretiert, muss klar sein, was das Modell können soll. Geht es um Coding? Um RAG? Um strategische Texte? Um Agent-Workflows? Um wissenschaftliche Recherche? Um Transkription und Extraktion?

Ohne diese Frage ist jeder Benchmark nur bunte Dekoration.

Zweitens: Welcher Benchmark passt zu dieser Fähigkeit?

Danach prüft man, welche Benchmarks überhaupt etwas mit dem eigenen Use Case zu tun haben.

- Für Coding: eher HumanEval, SWE-bench, agentische Tool-Use-Benchmarks.

- Für wissenschaftliche Tiefe: eher GPQA, HLE, MMLU-Pro.

- Für Chat-Qualität: eher MT-Bench, Chatbot Arena.

- Für allgemeine Orientierung: MMLU-Pro als breiter, aber nicht hinreichender Indikator.

Drittens: Wie groß ist der Unterschied wirklich?

Wenn zwei Modelle fast gleichauf liegen, sollte man Vorsicht walten lassen. Ein minimaler Vorsprung auf einem Benchmark ist selten allein entscheidungsrelevant. Spannend wird es erst, wenn sich ein Modell über mehrere relevante Benchmarks hinweg konsistent absetzt.

Viertens: Wie wurde gemessen?

Gibt es Informationen zu Prompting, Anzahl der Versuche, Tool-Nutzung, Temperatur, Kontextlänge und Auswertungsmethode? Wenn diese Informationen fehlen, sollte man die Zahlen nur eingeschränkt ernst nehmen.

Fünftens: Stimmen unabhängige Quellen grob überein?

Wenn ein Anbieter einen dramatischen Vorsprung behauptet, sollte man prüfen, ob unabhängige Leaderboards, Analysen oder Community-Erfahrungen ein ähnliches Bild zeigen. Wenn nicht, ist Skepsis angebracht.

Der wichtigste Punkt für Unternehmen: Öffentliche Benchmarks ersetzen keine internen Evals

Für Unternehmen liegt hier die eigentliche Quintessenz. Öffentliche Benchmarks sind hilfreich, um den Markt zu scannen und Kandidaten zu identifizieren. Aber sie beantworten nicht zuverlässig, welches Modell in deinem Unternehmen am besten funktioniert.

Dafür braucht es eigene Evaluierungen.

Wer Modelle ernsthaft auswählt, sollte eine kleine interne Benchmark-Suite aufbauen, die reale Aufgaben aus dem eigenen Umfeld abbildet. Das können zum Beispiel sein:

- echte Support-Anfragen,

- typische E-Mail-Entwürfe,

- Coding-Tasks aus realen Projekten,

- Zusammenfassungen interner Dokumente,

- RAG-Fragen über eigene Wissensbasen,

- Tool-Aufrufe in typischen Agent-Workflows,

- Qualitätskriterien wie Genauigkeit, Stil, Vollständigkeit und Halluzinationsrate.

Erst diese Kombination aus öffentlichen Benchmarks und eigenen Evaluierungen führt zu belastbaren Entscheidungen. Die öffentlichen Benchmarks helfen beim Vorsortieren. Die internen Evals entscheiden darüber, was im Alltag wirklich überzeugt.

Eine einfache Denkregel für die Praxis

Wenn du das nächste Mal eine Launch-Grafik mit zehn Benchmark-Balken siehst, dann lies sie nicht mit der Frage „Wer hat gewonnen?“, sondern mit diesen Fragen:

- Welche Fähigkeit wird hier überhaupt gemessen?

- Ist diese Fähigkeit für meinen Use Case relevant?

- Ist der Vorsprung groß oder nur kosmetisch?

- Wurde fair verglichen?

- Bestätigen andere Quellen diesen Eindruck?

- Würde ich dieses Modell deshalb tatsächlich produktiv einsetzen?

Wer so liest, wird deutlich resistenter gegen Benchmark-Marketing.

Was Benchmarks leisten — und was nicht

Benchmarks sind weder wertlos noch allmächtig. Sie sind ein wichtiges Werkzeug, solange man ihre Grenzen kennt.

Sie leisten viel, wenn es darum geht,

- grobe Leistungsunterschiede sichtbar zu machen,

- neue Modellgenerationen einzuordnen,

- Spezialstärken zu identifizieren,

- Forschung und Fortschritt messbar zu machen.

Sie leisten wenig, wenn man von ihnen erwartet,

- den besten Allrounder für jeden Kontext zu benennen,

- reale Produktionsqualität vollständig abzubilden,

- Sicherheit, Zuverlässigkeit und wirtschaftlichen Nutzen allein zu garantieren.

Gerade im Unternehmenskontext sollte man Benchmarks deshalb wie Due-Diligence-Material behandeln: relevant, aber nie allein entscheidend.

Fazit ohne Marketing-Brille

Die KI-Branche liebt Superlative. Jedes neue Modell ist angeblich smarter, sicherer, schneller und günstiger als die Konkurrenz. Benchmarks liefern dafür die visuelle Munition. Doch ein Benchmark ist kein Orakel. Er ist ein Messinstrument mit Stärken, Schwächen und einem klar begrenzten Aussagebereich.

Wer Benchmarks richtig lesen will, braucht keinen Doktortitel in Machine Learning. Es reicht, ein paar Prinzipien konsequent anzuwenden: Verstehe, was gemessen wird. Prüfe, ob es für dich relevant ist. Misstraue isolierten Siegercharts. Achte auf faire Vergleichsbedingungen. Und vor allem: Teste Modelle an deinen eigenen Aufgaben.

Dann werden Benchmarks nicht länger zu einem Nebel aus Akronymen und Marketingfolien, sondern zu dem, was sie eigentlich sein sollten: ein hilfreicher Kompass in einem unübersichtlichen Markt.

Liste wichtiger Benchmarks

Allgemeine Wissens- und Reasoning-Benchmarks

| Benchmark | Kategorie | Was wird gemessen? | Wofür ist er gedacht? |

|---|---|---|---|

| MMLU | Allgemeinwissen / Reasoning | Breites Wissen über viele Fachgebiete, meist Multiple-Choice | Allgemeine Grundfähigkeit eines Modells in Wissen und Schlussfolgern |

| MMLU-Pro | Allgemeinwissen / Frontier-Reasoning | Schwerere, robustere Version von MMLU mit anspruchsvolleren Fragen | Bessere Unterscheidung starker Modelle, wenn klassisches MMLU zu leicht geworden ist |

| BIG-Bench | Allgemeine Fähigkeiten | Große Sammlung sehr unterschiedlicher Aufgaben | Breiter Stresstest für vielseitige Modellfähigkeiten |

| BBH (BIG-Bench Hard) | Schwieriges Reasoning | Besonders schwere Teilmenge aus BIG-Bench | Vergleich fortgeschrittener Denk- und Transferfähigkeiten |

| ARC | Wissenschaftliches Reasoning | Schulnahe naturwissenschaftliche Fragen mit Logikanteil | Grundlegendes wissenschaftliches Denken und Verständnis |

| HellaSwag | Common Sense / Sprachverständnis | Plausible Fortsetzung von Situationen und Texten | Test für Alltagslogik und plausibles Sprachverständnis |

| TruthfulQA | Faktentreue / Halluzinationsresistenz | Ob ein Modell typische Irrtümer und Mythen vermeidet | Einschätzung, wie verlässlich ein Modell bei strittigen oder irreführenden Fragen ist |

| WinoGrande | Sprachverständnis / Common Sense | Auflösung von Mehrdeutigkeiten und Pronomenbezügen | Test für Sprachlogik und Kontextverständnis |

Mathematik- und formales Reasoning

| Benchmark | Kategorie | Was wird gemessen? | Wofür ist er gedacht? |

|---|---|---|---|

| GSM8K | Mathematisches Reasoning | Mathe-Textaufgaben auf Schulniveau mit mehreren Denkschritten | Bewertung von Schritt-für-Schritt-Denken und Rechenlogik |

| MATH | Schwierige Mathematik | Anspruchsvolle Mathematikaufgaben, teils Wettbewerbsniveau | Vergleich stärkerer Modelle im formalen mathematischen Denken |

Coding-Benchmarks

| Benchmark | Kategorie | Was wird gemessen? | Wofür ist er gedacht? |

|---|---|---|---|

| HumanEval | Code-Generierung | Ob generierter Python-Code definierte Tests besteht | Schneller Standardtest für die Fähigkeit, funktionierenden Code zu schreiben |

| MBPP | Code-Generierung | Kleinere Programmieraufgaben aus natürlicher Sprache | Ergänzender Coding-Test für eher kompakte Entwicklungsaufgaben |

| SWE-bench | Software Engineering | Ob ein Modell echte GitHub-Issues in realen Repositories lösen kann | Praxisnähere Bewertung für Debugging, Bugfixing und Repo-Verständnis |

| SWE-bench Verified | Software Engineering | Strengere, bereinigte Variante von SWE-bench | Verlässlichere Messung realer Softwareentwicklungs-Fähigkeiten |

Chat-, Dialog- und Assistenz-Benchmarks

| Benchmark | Kategorie | Was wird gemessen? | Wofür ist er gedacht? |

|---|---|---|---|

| MT-Bench | Konversation / Instruktionsbefolgung | Qualität in mehrstufigen Dialogen und bei Anweisungen | Bewertung klassischer Chat-Assistenten |

| Chatbot Arena | Chatqualität / Präferenzranking | Welche Modellantworten in Blindvergleichen bevorzugt werden | Praktischer Marktindikator für wahrgenommene Chatqualität |

| Arena ELO | Leaderboard / Präferenz | Rangfolge aus vielen Paarvergleichen | Vergleich von Modellen aus Sicht realer Nutzerpräferenzen |

Agenten- und Tool-Use-Benchmarks

| Benchmark | Kategorie | Was wird gemessen? | Wofür ist er gedacht? |

|---|---|---|---|

| BFCL | Tool-Use / Function Calling | Ob ein Modell passende Funktionen korrekt auswählt und aufruft | Bewertung von Agenten, die APIs, Tools oder Funktionen nutzen |

| Tool-Use-Benchmarks allgemein | Agentisches Verhalten | Planung, Auswahl und korrekte Nutzung externer Werkzeuge | Relevant für KI-Agenten, Automationen und Assistenzsysteme mit Aktionen |

Frontier-Benchmarks

| Benchmark | Kategorie | Was wird gemessen? | Wofür ist er gedacht? |

|---|---|---|---|

| Humanity’s Last Exam (HLE) | Frontier-Reasoning / Expertenniveau | Sehr schwere, fachlich anspruchsvolle Fragen aus vielen Disziplinen | Prüfung, wie nah ein Modell an tiefes Expertenwissen und anspruchsvolles akademisches Denken herankommt |

| GPQA | Wissenschaftliches Frontier-Reasoning | Graduierten-Niveau in Biologie, Physik und Chemie | Messung wissenschaftlicher Tiefe und „google-resistenter“ Fachkompetenz |

| GPQA Diamond | Wissenschaftliches Frontier-Reasoning | Besonders schwere Teilmenge von GPQA | Schärferer Vergleich sehr starker Modelle in naturwissenschaftlichem Denken |

| FrontierScience | Frontier-Wissenschaft | Sehr schwierige wissenschaftliche Aufgaben und Forschungsnähe | Einschätzung, wie gut Modelle in hochanspruchsvollen wissenschaftlichen Domänen sind |

Multilingualität und Übersetzung

| Benchmark | Kategorie | Was wird gemessen? | Wofür ist er gedacht? |

|---|---|---|---|

| MGSM | Mehrsprachiges Reasoning | Mathematische Aufgaben in mehreren Sprachen | Test, ob Reasoning auch außerhalb des Englischen stabil bleibt |

| XQuAD | Mehrsprachiges Sprachverständnis | Frage-Antwort-Verständnis in mehreren Sprachen | Bewertung multilingualer QA-Fähigkeiten |

| Flores | Übersetzung / Multilingualität | Übersetzungsqualität über viele Sprachpaare | Vergleich multilingualer Sprach- und Übersetzungsmodelle |

Sicherheit, Robustheit und Governance

| Benchmark | Kategorie | Was wird gemessen? | Wofür ist er gedacht? |

|---|---|---|---|

| HELM | Ganzheitliche Evaluation | Leistung, Robustheit, Kalibrierung, Bias, Toxizität, Effizienz | Umfassender Rahmen für seriöse Modellbewertung über mehrere Dimensionen |

| Safety-Benchmarks | Sicherheit / Alignment | Schädliche, toxische, manipulative oder unerwünschte Ausgaben | Bewertung von Sicherheitsverhalten und Policy-Compliance |

| Toxizitäts- und Bias-Suiten | Fairness / Risiko | Verzerrungen, diskriminierende Sprache, problematische Inhalte | Besonders wichtig für Compliance, öffentliche Anwendungen und Risikoanalysen |

Leaderboards und Benchmark-Sammlungen

| Name | Kategorie | Was wird abgebildet? | Wofür ist es gedacht? |

|---|---|---|---|

| Hugging Face Open LLM Leaderboard | Leaderboard | Sammlung mehrerer Benchmarks für Open-Source-Modelle | Schneller Überblick über die Leistung offener Modelle |

| Stanford HELM | Evaluations-Framework | Viele Szenarien und Metriken statt nur ein einzelner Score | Ganzheitlicher Modellvergleich |

| Chatbot Arena Leaderboard | Community-Leaderboard | Rangliste auf Basis von Nutzerpräferenzen | Marktnahe Bewertung von Chatmodellen |

| Kommerzielle LLM-Leaderboards | Marktvergleich | Benchmark-, Preis- und teils Latenzvergleiche | Praktische Vorauswahl für Modellentscheidungen |