Stellen Sie sich vor, eine neue Ausschreibung landet in Ihrem Postfach — 180 Seiten, voller Anforderungen, Zertifikatsauflagen und Leistungskriterien. Ihr Team verbringt drei Tage damit, herauszufinden, ob das Projekt überhaupt zu Ihnen passt. Dann entscheidet jemand im Meeting: „Wir machen mit." Fünf Wochen später verlieren Sie den Bid, weil eine Pflichtqualifikation fehlte, die auf Seite 142 versteckt war.

Dieses Szenario ist kein Einzelfall — es ist industrieller Standard. Laut einer Analyse von DreamAI Software dauert die Bearbeitung eines komplexen RFPs bei Ingenieurbüros im Schnitt 8 bis 10 Wochen. Mit einem Multi-Agenten-System reduzierten sie diese Zeit auf unter 2 Wochen — bei 95 % Treffergenauigkeit beim Matching gegen die eigene Projekthistorie.

Die Frage ist nicht mehr ob KI-Agenten hier helfen können. Die Frage ist: Wie baut man so ein System — und worauf kommt es wirklich an?

Warum klassische RFP-Prozesse strukturell scheitern

Das Problem ist kein Kompetenzproblem. Es ist ein Informationsverarbeitungsproblem.

Ein typischer RFP kombiniert:

- Eignungskriterien (Zertifikate, Referenzen, Umsatzschwellen)

- Leistungsbeschreibungen (technische Anforderungen, Lieferumfang)

- Formale Ausschlussgründe (fehlende Nachweise, Fristen, Set-aside-Klauseln)

- Strategische Passung (Branchenfokus, Projektgröße, geografische Lage)

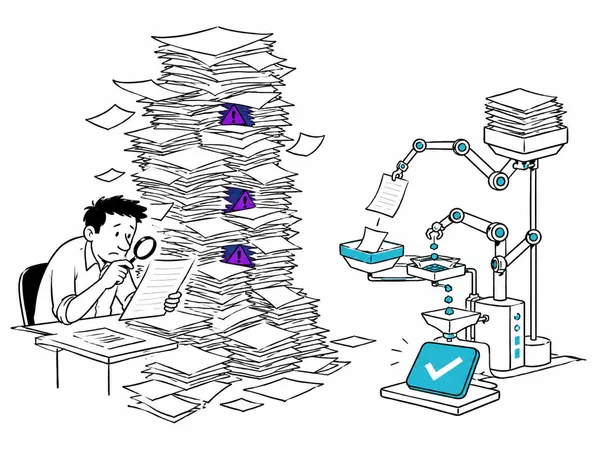

Ein Mensch liest linear. Ein KI-Agent verarbeitet alle Dimensionen parallel und strukturiert — und zieht dabei gleichzeitig auf eine vektorisierte Wissensbasis zurück, die Ihre gesamte Unternehmenshistorie enthält.

Wie Agentic AI den RFP-Prozess neu strukturiert

Moderne Ansätze setzen auf spezialisierte Agenten, die wie ein eingespieltes Analyseteam zusammenarbeiten — jeder mit einer klaren Aufgabe, alle auf dasselbe Ziel ausgerichtet: eine begründete, datengestützte Bid/No-Bid-Empfehlung.

Agent 1: Der Extraktor

Der erste Agent liest das RFP-Dokument (PDF, Word, E-Mail) und zerlegt es in strukturierte Datenpunkte:

- Pflichtanforderungen vs. optionale Kriterien

- Fristen und Einreichungsformate

- Geforderte Zertifikate (z. B. ISO 27001, CMMC Level 2, DIN-Normen)

- Mindest-Referenzprojekte und Umsatzgrenzen

Das CES-System, das 83 % aller eingehenden RFPs ohne manuelle Prüfung verarbeitete, setzt genau hier an: Ein spezialisierter RFP Parser Agent übernimmt die Erstverarbeitung und leitet strukturierte Daten an nachgelagerte Agenten weiter.

Agent 2: Der Qualifikationsprüfer

Dieser Agent führt einen harten Gate-Check durch — binär, keine Graubereiche:

Ist Zertifikat X aktuell und gültig? Haben wir Referenzprojekte der geforderten Größenordnung? Sind wir in der geforderten Region lieferfähig?

Das Tribble-AI-Framework beschreibt diesen zweistufigen Ansatz präzise: Erst ein Pass/Fail-Gate auf Pflichtkriterien, danach ein gewichtetes Scoring-Modell (Pwin) für die strategische Bewertung. Zertifikate, die „in Bearbeitung" oder „in Erneuerung" sind, passieren den Gate nicht — ein häufiger und teurer Fehler in manuellen Prozessen.

Agent 3: Der Projekthistorie-Matcher

Hier liegt der eigentliche Kern des Systems — und die größte Hebelwirkung.

Der Matcher durchsucht eine vektorisierte Datenbank (RAG: Retrieval-Augmented Generation) mit allen vergangenen Projekten, Referenzblättern und Angebotsunterlagen des Unternehmens. Er beantwortet semantisch:

„Haben wir ein Projekt realisiert, das diesem hier ähnlich genug ist, um als qualifizierendes Referenzprojekt zu gelten?"

Das ist kein Keyword-Matching. Das Ingenieursbüro RHC Engineering indexierte über 150 Lebensläufe, Projektdatenblätter und Rechtsdokumente in einer Vektordatenbank (LanceDB) und erzielte dabei eine Matching-Genauigkeit von ~95 % — bei einer Fehlerreduzierung in der Risikoanalyse von 40 %.

Agent 4: Der Machbarkeits- und Risikobewerter

„Machbarkeit" ist im deutschsprachigen Ausschreibungskontext ein vielschichtiger Begriff: Können wir die Leistung fristgerecht erbringen? Haben wir die richtigen Ressourcen verfügbar? Sind Teilleistungen rechtlich oder technisch problematisch?

Dieser Agent bewertet:

- Ressourcenverfügbarkeit (sind Schlüsselpersonen für den Zeitraum einsetzbar?)

- Technische Machbarkeit (haben wir Erfahrung mit den geforderten Technologien?)

- Risikofaktoren (unklare Anforderungen, sehr kurze Lieferzeiten, ungewöhnliche Haftungsklauseln)

Microsofts Open-Source Solution Accelerator für RFP-Response geht hier sogar weiter: Der Agent berechnet automatisch einen Confidence Score für die generierte Antwort und markiert Abschnitte, bei denen die Wissensbasis dünn ist.

Agent 5: Die Bid/No-Bid-Entscheidungsinstanz

Der finale Agent synthetisiert alle Inputs und produziert eine erklärbare Empfehlung — keine Black Box:

- Gesamtbewertung (z. B. 72/100)

- Kritische Lücken (Must-have-Kriterien, die nicht erfüllt sind)

- Stärken im Vergleich zum Wettbewerb

- Empfehlung: Go / Conditional Go / No-Bid — mit Begründung und Confidence-Level

Die technische Grundlage: RAG + spezialisierte Agenten

Das Herzstück jedes solchen Systems ist eine private, unternehmenseigene Wissensbasis, aufgebaut mit Retrieval-Augmented Generation (RAG):

- Indexierung: Alle relevanten Unternehmensdokumente (Projektblätter, Zertifikate, frühere Angebote, CVs) werden in Vektoren umgewandelt und in einer Vektordatenbank gespeichert (z. B. Pinecone, LanceDB, Azure AI Search).

- Retrieval: Bei jedem neuen RFP sucht der Agent semantisch — nicht nur per Schlüsselwort — nach den relevantesten Dokumenten aus dem eigenen Bestand.

- Generation: Ein LLM (GPT-4, Claude 3.5, Gemini) generiert strukturierte Outputs, verankert in den eigenen Quellen — damit werden Halluzinationen systematisch reduziert.

Wichtig für sensible Ausschreibungen: Wie Cabrillo Club in einer technischen Analyse betont, sollte die Wissensbasis isoliert und nicht mandantenübergreifend betrieben werden — besonders wenn vertrauliche Projektdaten oder behördenrelevante Informationen enthalten sind.

Was die Zahlen sagen

Die Ergebnisse aus realen Implementierungen sprechen für sich:

| Metrik | Vorher (manuell) | Nachher (KI-Agenten) |

|---|---|---|

| RFP-Bearbeitungszeit | 8–10 Wochen | ~2 Wochen (−75 %) |

| Manuelle Review-Quote | 100 % | 17 % (CES-System) |

| Matching-Genauigkeit | subjektiv | ~95 % |

| Fehler in Risikoanalyse | Baseline | −40 % |

| Bearbeitete RFPs/Jahr | limitiert | +25 ohne mehr Headcount |

Was gute Implementierungen von schlechten unterscheidet

Drei kritische Erfolgsfaktoren aus der Praxis:

1. Human-in-the-Loop bleibt unverzichtbar — Die besten Systeme sind semi-automatisiert. Agenten erstellen die Analyse und den Entwurf; Fachleute prüfen und entscheiden final. Das ist kein Rückschritt, sondern klug: Die menschliche Expertise wird auf die Stellen konzentriert, wo sie wirklich gebraucht wird.

2. Die Qualität der Wissensbasis entscheidet alles — Garbage in, garbage out. Wenn die Projekthistorie unvollständig, unstrukturiert oder veraltet ist, liefert auch der beste Agent schwache Ergebnisse. Die Datenpflege ist kein technisches Problem — es ist eine organisatorische Führungsaufgabe.

3. Erklärbarkeit ist kein Nice-to-have — Besonders in regulierten Märkten oder bei öffentlichen Vergaben müssen Entscheidungen nachvollziehbar sein. Systeme, die mit Seitenzahl-Referenzen und Quellennachweisen arbeiten, schaffen Vertrauen — intern wie extern.

Fazit: Die nächste Ausschreibung wartet nicht auf Ihr Team

Die Frage, ob ein RFP zu Ihnen passt, ist heute keine Frage der Erfahrung mehr — sie ist eine Frage der Datenverfügbarkeit und Verarbeitungsgeschwindigkeit. KI-Agenten können beides liefern: systematisch, skalierbar und erklärbar.

Wer jetzt beginnt, seine Projekthistorie zu strukturieren und eine private Wissensbasis aufzubauen, verschafft sich einen dauerhaften Wettbewerbsvorteil — nicht nur bei der Angebotserstellung, sondern bei der strategischen Frage: Welche Ausschreibungen wollen wir überhaupt gewinnen?

Der erste Schritt ist kleiner als gedacht: Beginnen Sie mit 20 Ihrer besten Referenzprojekte, einem klaren Kriterienkatalog für Must-have-Qualifikationen — und einem Agenten, der beides zusammenbringt.